Brenda Ahearn, techniek in Michigan

Roombas kunnen comfortabel en leuk zijn, vooral voor katten die graag op de machines rijden tijdens het schoonmaken. Maar obstakelvermijdingscamera’s verzamelen beelden van de omgeving – soms heel persoonlijke beelden, zoals het geval was in 2020 toen beelden van een jonge vrouw in een toilet, vastgelegd door Romba, naar sociale media lekten nadat ze naar een cloudserver waren geüpload. Het is een lastig probleem in dit zeer online digitale tijdperk, waarin camera’s met internetverbinding worden gebruikt in een verscheidenheid aan toepassingen voor thuis- en gezondheidstoezicht, maar ook in meer publieke toepassingen zoals autonome voertuigen en beveiligingscamera’s.

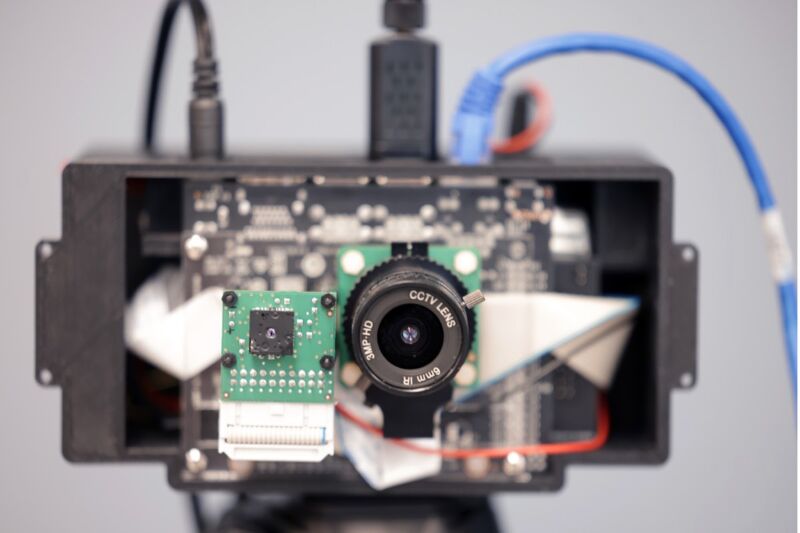

Ingenieurs van de Universiteit van Michigan (UM) ontwikkelen een mogelijke oplossing: PrivacyLens, een nieuwe camera die mensen in afbeeldingen kan detecteren op basis van lichaamstemperatuur en hun gelijkenis kan vervangen door een generiek figuur. Ze dienden een voorlopig patent in voor het apparaat, beschreven in een recent artikel gepubliceerd in het Proceedings on Privacy Enhancing Technologies Symposium, dat vorige maand werd gehouden.

“De meeste consumenten denken niet na over wat er gebeurt met de gegevens die worden verzameld door hun favoriete smart home-apparaten. In de meeste gevallen worden onbewerkte audio, afbeeldingen en video vanaf deze apparaten gestreamd naar de cloudgebaseerde servers van de fabrikant, ongeacht of er al dan niet gegevens worden opgeslagen. daadwerkelijk nodig is voor de eindtoepassing”, zegt co-auteur Alanson Sample. “Een slim apparaat dat persoonlijk identificeerbare informatie (PII) verwijdert voordat gevoelige gegevens naar privéservers worden verzonden, zal een veel veiliger product zijn dan wat we momenteel hebben.”

De auteurs identificeerden drie verschillende soorten beveiligingsbedreigingen die verband houden met dergelijke apparaten. Het Roomba-incident is een voorbeeld van buitensporige gegevensverzameling, die verder gaat dan waarvoor de gebruiker mogelijk willens en wetens heeft ingestemd met het verzamelen ervan, samen met geautoriseerde toegang en ongeautoriseerd delen. (Concertmedewerkers in Venezuela, belast met het taggen van AI-trainingsgegevens, plaatsten de onthullende beelden op internetforums.) Een externe hacker vertegenwoordigt ongeoorloofde toegang.

Slimme deurbellen hebben bijvoorbeeld ‘gecodeerde’ camerakanalen, zodat gebruikers kunnen voelen dat hun privacy veilig is. Maar dergelijke feeds zijn toegankelijk voor medewerkers van apparaatfabrikanten, datamakelaars, derden of wetshandhavingsinstanties, maar ook voor hackers. Toen CCTV-camera’s bij de ingang van de metro in Massachusetts in 2012 een vrouw vastlegden die van een roltrap viel, deelde iemand van de Massachusetts Bay Transportation Authority op onverklaarbare wijze de video met verslaggevers en op YouTube. Het werd snel verwijderd, maar niet voordat er veel kopieën van waren gemaakt. De video onthulde PII zoals haar gezicht, haarkleur en huidskleur.

Geen onnodig toezicht

De meeste privacybeschermende benaderingen zijn gericht op het verwijderen van ROI-details (regio of interest) om persoonlijke gegevens te ‘opschonen’ in afbeeldingen in ware kleuren (RBG) buiten het apparaat. Ze zijn echter gevoelig voor omgevings- en lichtinvloeden die volgens de auteurs tot informatielekken kunnen leiden. Om deze problemen op te lossen, ontwikkelden zij PrivacyLens.

Brenda Ahearn, techniek in Michigan

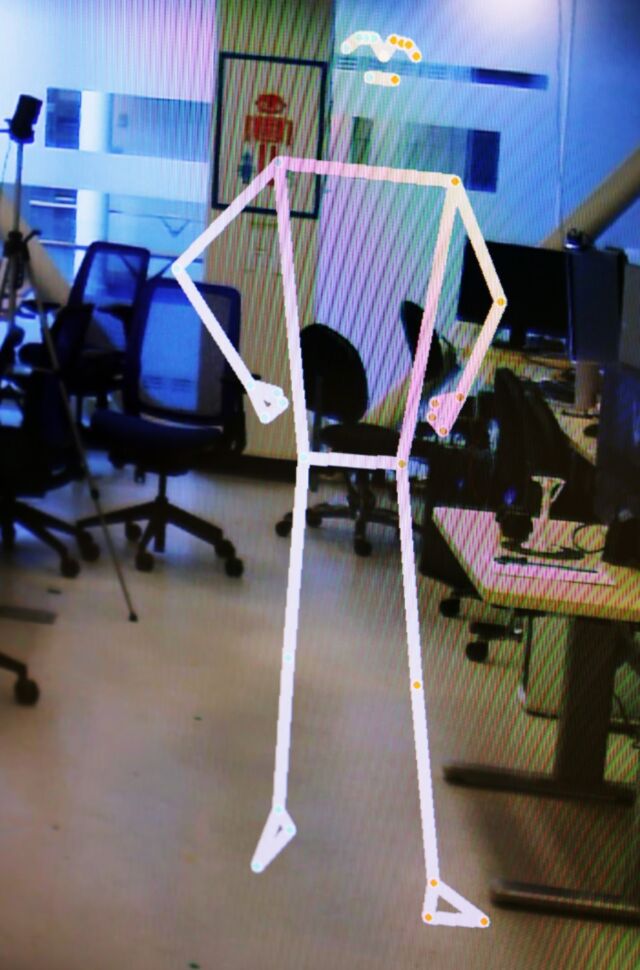

PrivacyLens werkt op batterijen en combineert RGB en thermische beeldvorming met een ingebouwde GPU die PII kan verwijderen voordat er gegevens worden opgeslagen of naar een server worden verzonden, met name gezicht, huidskleur, haarkleur, lichaamsvorm en geslachtskenmerken. Thermische beeldvorming betekent dat mensen in afbeeldingen kunnen worden gedetecteerd en “afgetrokken” van afbeeldingen op basis van hun thermische silhouetten, en deze kunnen vervangen door een geanimeerd stokfiguur. De camera kan nog steeds functioneren, maar de identificerende kenmerken van de persoon blijven beschermd. Uit het toepassingsonderzoek, uitgevoerd in een kantooratrium, een gezinswoning en een buitenpark, bleek dat PrivacyLens PII in 99,1 procent van de afbeeldingen verwijderde, vergeleken met ongeveer 57,6 procent bij gebruik van alleen RGB-methoden.

Er zijn zes verschillende modi, afhankelijk van hoeveel persoonlijke gegevens de gebruiker wil verwijderen. Het kan bijvoorbeeld prima zijn om simpelweg uw gelaatstrekken te verwisselen voor een algemeen gezicht (face swap-modus) wanneer u thuis in de keuken bent, of te kiezen voor een volledige verwijdering in de slaapkamer of badkamer (spookmodus). Dit komt overeen met de bevindingen van een kleine pilotstudie uitgevoerd door het team, waaruit ook lagere verwachtingen ten aanzien van privacy in openbare omgevingen naar voren kwamen, en dus minder behoefte aan agressievere manieren van werken.

“Camera’s bieden rijke informatie voor gezondheidsmonitoring. Ze kunnen helpen bij het volgen van bewegingsgewoonten en andere activiteiten in het dagelijks leven, of om hulp roepen als een oudere persoon valt”, zegt co-auteur Yasha Iravantchi, een afgestudeerde student aan de UM. “Maar dit vormt een ethisch dilemma voor de mensen die baat zouden hebben bij deze technologie. Zonder de privacy te beperken, presenteren we een situatie waarin ze moeten afwegen om hun privacy op te geven in ruil voor goede chronische zorg. Dit apparaat zou ons in staat kunnen stellen waardevolle medische zorg te verkrijgen gegevens met behoud van de privacy van de patiënt.” PrivacyLens zou ook het gebruik van autonome voertuigen of bewakingscamera’s buitenshuis kunnen voorkomen, wat in strijd is met de privacywetten.

DOI: Proceedings on Privacy Enhancing Technologies Symposium, 2024. 10.56553/popets-2024-0146 (Over DOI).