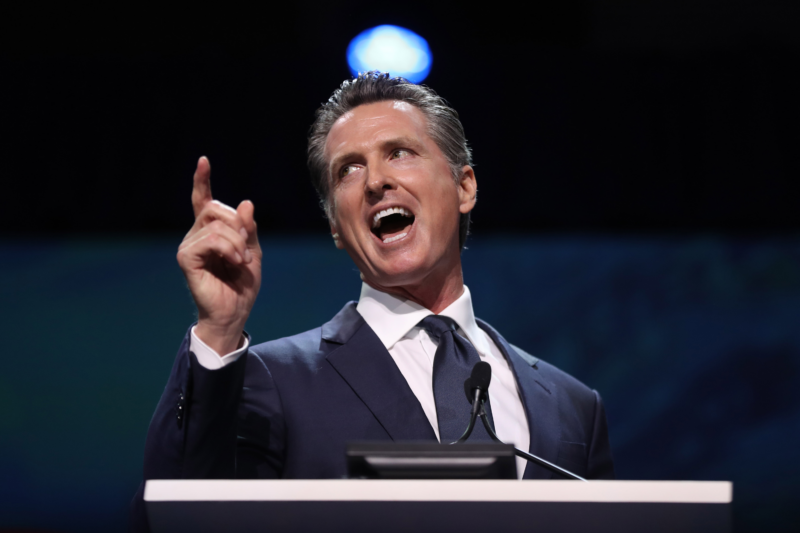

Ray Chavez/The Mercury News via Getty Images

Een controversieel wetsvoorstel gericht op het afdwingen van veiligheidsnormen voor grootschalige kunstmatige-intelligentiemodellen is nu met 45 tegen 11 stemmen door de staatsvergadering van Californië aangenomen. Na een stemming van 32 tegen 1 in de Senaat in mei, staat SB-1047 nu voor nog slechts één procedurele stemming in de Senaat voordat hij naar het bureau van gouverneur Gavin Newsom gaat.

Zoals we eerder in detail hebben onderzocht, vereist SB-1047 dat makers van AI-modellen een ‘kill switch’ implementeren die kan worden geactiveerd als dat model ‘nieuwe bedreigingen voor de openbare veiligheid en beveiliging’ begint te introduceren, vooral als het ‘met beperkte middelen’ werkt. menselijk toezicht, interventie of supervisie.” Sommigen hebben het wetsvoorstel bekritiseerd omdat het zich concentreert op de ongebruikelijke risico’s van ingebeelde toekomstige kunstmatige intelligentie in plaats van op de echte, huidige schade van AI-gebruiksscenario’s, zoals deep fakes of verkeerde informatie.

Bij de aankondiging van de goedkeuring van het wetsvoorstel woensdag haalde wetsvoorstelsponsor en staatssenator Scott Weiner de steun aan van beroemdheden uit de AI-industrie, zoals Geoffrey Hinton en Yoshua Bengio (die beiden vorig jaar ook een verklaring ondertekenden waarin werd gewaarschuwd voor het “risico van uitsterven” van de zich snel ontwikkelende AI-technologie intelligentie).

In een recent redactioneel commentaar van Fortune zei Bengio dat het wetsvoorstel “het absolute minimum beschrijft voor effectieve regulering van grensverleggende AI-modellen” en dat de focus op grote modellen (die meer dan $100 miljoen kosten om te trainen) elke impact op kleinere startups zal vermijden.

“We kunnen niet toestaan dat bedrijven hun huiswerk beoordelen en alleen maar mooi klinkende garanties geven”, schreef Bengio. “We accepteren dit niet in andere technologieën zoals de farmaceutische industrie, de ruimtevaart en de voedselveiligheid. Waarom zou AI anders behandeld moeten worden?”

Maar in een afzonderlijk Fortune-hoofdartikel eerder deze maand betoogde Stanford computerwetenschapper en expert op het gebied van kunstmatige intelligentie Fei-Fei Li dat het ‘goedbedoelde’ wetsvoorstel ‘aanzienlijke onbedoelde gevolgen zal hebben, niet alleen voor Californië maar voor het hele land’.

Het opleggen van wettelijke aansprakelijkheid aan de oorspronkelijke ontwikkelaar van welk gewijzigd model dan ook zal “ontwikkelaars dwingen zich terug te trekken en defensief te handelen”, betoogde Li. Dit zal het delen van AI-gewichten en open-sourcemodellen beperken, wat een aanzienlijke impact zal hebben op academisch onderzoek, schreef ze.

Wat gaat Newsom doen?

Een groep zakenleiders uit Californië stuurde woensdag een open brief waarin ze er bij Newsom op aandrongen een veto uit te spreken over het ‘fundamenteel gebrekkige’ wetsvoorstel dat ‘de ontwikkeling van modellen onvoldoende reguleert in plaats van misbruik’. Het ontwerp zou “lastige nalevingskosten met zich meebrengen” en “investeringen en innovatie afremmen door dubbelzinnigheid op het gebied van de regelgeving”, aldus de groep.

Gouverneur Newsom spreekt over AI-kwesties tijdens een symposium in mei.

Als de Senaat de versie van het Huis van Afgevaardigden zoals verwacht bevestigt, heeft Newsom tot 30 september de tijd om te beslissen of het wetsvoorstel in wet wordt omgezet. Als er een veto wordt uitgesproken, kan de wetgevende macht het voorstel terzijde schuiven met een tweederde meerderheid in elke kamer (een sterke mogelijkheid gezien de overweldigende meerderheid van de stemmen voor het wetsvoorstel).

Op een symposium van UC Berkeley in mei zei Newsom dat hij bezorgd was dat “we onszelf in een gevaarlijke positie zouden kunnen brengen als we overreguleren, als we te ver reiken, als we het glimmende object achtervolgen.”

Tegelijkertijd zei Newsom dat deze zorgen over overregulering worden gecompenseerd door zorgen die hij heeft gehoord van leiders in de kunstmatige intelligentie-industrie. “Als je de uitvinders van deze technologie hebt, de peetvaders en vaders, die zeggen: ‘Help, je moet ons reguleren’, dan is het een heel andere omgeving”, zei hij op het symposium. “Als ze zich haasten om mensen voor te lichten en in feite zeggen: ‘We weten echt niet wat we hebben gedaan, maar je moet er iets aan doen’, dan is dat een interessante omgeving.”