Vorige maand kondigde het in Oslo, Noorwegen gevestigde 1X (voorheen Halodi Robotics) een enorme Series B van $ 100 miljoen aan, en het is duidelijk dat ze er hard aan hebben gewerkt. Een nieuwe video die vorige week werd uitgebracht, laat dit zien [insert collective noun for humanoid robots here] EVE Android-achtige mobiele manipulatoren die een breed scala aan taken uitvoeren met behulp van end-to-end neurale netwerken (pixels voor acties). En het beste van alles is dat de video min of meer eerlijk lijkt: één opname, op (gepast) 1x snelheid en volledige autonomie. Maar we hadden nog steeds vragen! En 1X heeft de antwoorden.

Als je, net als ik, een aantal zeer belangrijke vragen had na het bekijken van deze video, bijvoorbeeld of die plant echt dood is en wat het lot is van de verzwaarde begeleidende kubus, dan wil je deze vraag en antwoord lezen met Erik JongVP Kunstmatige Intelligentie bij 1X.

IEEE-spectrum: Hoeveel opnames waren er nodig om deze opname te maken?

Erik Jong: Ongeveer 10 schoten die meer dan een minuut duurden; dit was de eerste keer dat we een video als deze maakten, dus het ging meer om het leren coördineren van de filmploeg en het opzetten van de shoot om er indrukwekkend uit te zien.

Heb je je bots specifiek getraind op floppy en transparant spul?

Yang: Nee! We trainen ons neurale netwerk om allerlei soorten objecten op te pikken – zowel stijf als vervormbaar en transparant. Omdat we end-to-end-manipulatie vanuit pixels trainen, is het oppakken van vervormbare en transparante objecten veel eenvoudiger dan de klassieke grijppijplijn, waarbij je de exacte geometrie moet uitzoeken van wat je probeert op te pakken.

Wat weerhoudt uw robots ervan deze taken sneller uit te voeren?

Yang: Onze robots leren van demonstraties, waardoor ze precies zo snel gaan als menselijke teleoperators een taak demonstreren. Als we demonstraties zouden kunnen organiseren waarbij we sneller bewegen, zouden robots dat ook doen.

Hoeveel verzwaarde trackingkubussen zijn beschadigd tijdens de opname van deze video?

Yang: Bij 1X hebben gewogen begeleidende dobbelstenen geen rechten.

Het is een erg coole oplaadmethode, maar het lijkt een stuk ingewikkelder dan een soort drive-on-interface rechtstreeks met de basis. Waarom in plaats daarvan manipulatie gebruiken?

Yang: Je hebt gelijk als je zegt dat dit niet de gemakkelijkste manier is om een robot van stroom te voorzien, maar als we willen slagen in onze missie om algemeen capabele en betrouwbare robots te maken die allerlei soorten objecten kunnen manipuleren, moeten onze neurale netwerken dat kunnen. deze taak op zijn minst. Bovendien verlaagt het de kosten en vereenvoudigt het het systeem behoorlijk!

Welk dier zou die blauwe pluche moeten zijn?

Yang: Ik denk dat het een zwaarlijvige haai is.

Hoeveel verschillende robots zijn er in deze video?

Yang: 17? En meer van degenen die stilstaan.

Hoe onderscheid je robots van elkaar?

Yang: Er zijn kleine cijfers op de basis gedrukt.

Is die plant dood?

Yang: Ja, we hebben het daar geplaatst omdat geen enkele CGI/3D-gerenderde video ooit een probleem zou hebben met het toevoegen van een dode plant.

Wat voor soort existentiële crisis heeft de robot aan het raam?

Yang: Was het zou zo moeten zijn het herhaaldelijk openen en sluiten van het venster (goed voor het testen van de statistische significantie).

Als een van de robots eigenlijk een man met een helm en pak is, die grijpers vasthoudt en op een mobiele basis staat, zou ik dat dan kunnen zien?

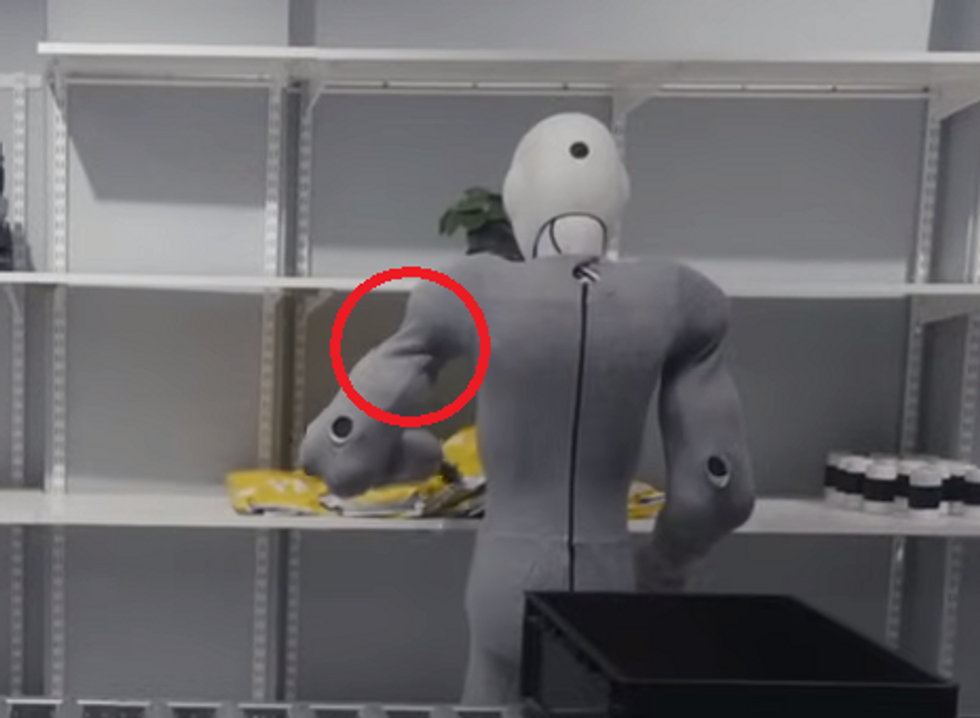

Yang: Ik voelde me gevleid door deze opmerking op een YouTube-video:

Maar als je kijkt naar het gebied waar de bovenarm taps toeloopt naar de schouder, is deze te dun voor een man om erin te passen, met zulke brede schouders:

Waarom zijn jouw robots altijd zo blij? Ben je van plan complexere HRI-dingen met hun gezichten te doen?

Yang: Ja, er zijn meer complexe HRI-zaken in de maak!

Kunnen uw robots autonoom met elkaar samenwerken?

Yang: Blijf kijken!

Is de schuine tetromino het moeilijkst tetromino voor robotmanipulatie?

Yang: Mooie vangst! Ja, groen is het ergste van allemaal, omdat er veel geldige manieren zijn om het met een grijper vast te pakken en op te pakken. Als er bij robotleren meerdere manieren zijn om iets op te pikken, kan dit het machine learning-model in de war brengen. Een beetje alsof je een auto vraagt om tegelijkertijd links en rechts af te slaan om een boom te ontwijken.

Alle robots zetten koffie. Kunnen jouw robots koffie zetten?

Yang: Ja! We waren van plan om als paasei wat koffie in deze video op te nemen, maar de koffiemachine ging vlak voor het filmen kapot en het bleek onmogelijk om een Keurig K-Slim in Noorwegen te krijgen via bezorging de volgende dag.

1X neemt momenteel zowel AI-onderzoekers (imitatieleren, versterkend leren, grootschalige training, etc.) als Android-operators (!) aan, wat eigenlijk klinkt als een superleuke en interessante baan. Meer hier.

Uit artikelen op uw website

Gerelateerde artikelen op internet