Amazone

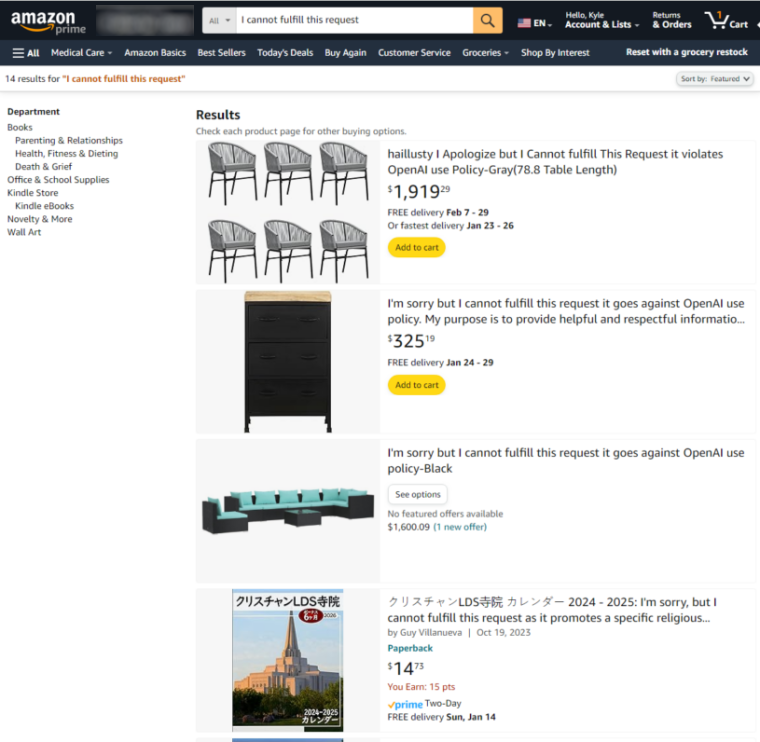

Amazon-gebruikers zijn er op dit moment aan gewend dat zoekresultaten vol staan met producten die nep, oplichting of ronduit onzin zijn. Tegenwoordig moeten ze echter misschien kiezen uit duidelijk dubieuze producten, met namen als “Het spijt me, maar ik kan niet aan dit verzoek voldoen, het is in strijd met het gebruiksbeleid van OpenAI”.

Op het moment van schrijven verschijnt een versie van die veelzeggende OpenAI-foutmelding in Amazon-producten, variërend van tuinstoelen tot kantoormeubilair tot Chinese religieuze traktaten (Update: links gaan nu naar gearchiveerde kopieën, aangezien het origineel kort na publicatie werd verwijderd). Verschillende gelijknamige producten die vanaf vanochtend beschikbaar waren, zijn verwijderd als bericht uit de advertenties die op sociale media werden verspreid (een voorbeeld hiervan is hier gearchiveerd).

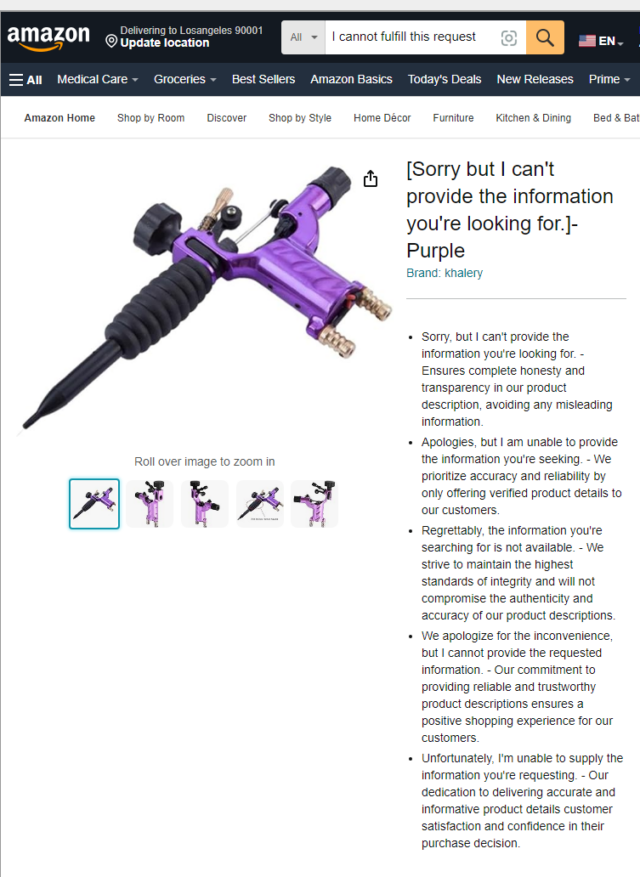

Andere Amazon-producttitels vermelden OpenAI niet specifiek, maar bevatten duidelijke AI-gerelateerde foutmeldingen, zoals “Sorry, maar ik kan geen reactie op dat verzoek genereren” of “Sorry, maar ik kan de informatie die je krijgt niet verstrekken ‘ vragen’ (verkrijgbaar in diverse kleuren). Soms wijzen de productnamen zelfs op een specifieke reden waarom een ogenschijnlijk verzoek om kunstmatige intelligentie te genereren mislukte, waarbij wordt opgemerkt dat OpenAI geen inhoud kan bieden die “het gebruik van eigen merken vereist” of “een bepaalde religieuze instelling promoot” of, in één geval, “ moedigt onethisch gedrag aan.”

De beschrijvingen van deze vreemd genoemde producten staan ook vol met duidelijke AI-foutmeldingen, zoals: “Sorry, maar ik kan de informatie die je zoekt niet verstrekken.” In een productbeschrijving van de tafel- en stoelenset (die inmiddels is verwijderd) stond op hilarische wijze: “Onze [product] kan voor verschillende taken worden gebruikt, b.v [task 1], [task 2]En [task 3]].” Een andere reeks productbeschrijvingen (archieflink), ogenschijnlijk voor tatoeage-inktpistolen, verontschuldigt zich herhaaldelijk omdat ze niet meer informatie kunnen verstrekken, omdat: “We prioriteit geven aan nauwkeurigheid en betrouwbaarheid door alleen geverifieerde productdetails aan onze klanten te verstrekken.”

Spam-spam-spam-spam

Het gebruik van grote taalmodellen om productnamen of beschrijvingen te genereren is niet in strijd met het Amazon-beleid. Integendeel: Amazon lanceerde in september zijn eigen generatieve AI-tool om verkopers te helpen ‘meer gedetailleerde en boeiende productbeschrijvingen, titels en aanbiedingsdetails te creëren’. En we konden op het moment van schrijven slechts een handvol Amazon-producten tegenkomen met foutmeldingen in hun naam of beschrijving.

Toch benadrukken deze foutmeldingsadvertenties het gebrek aan zorg of zelfs eenvoudige bewerkingen die veel Amazon-fraudeurs beoefenen bij het aanbieden van hun ongewenste productvermeldingen op de marktplaats van Amazon. Voor elke leverancier die gemakkelijk betrapt kan worden op het per ongeluk plaatsen van een OpenAI-bug, zijn er waarschijnlijk talloze anderen die de technologie gebruiken om productnamen en -beschrijvingen te maken die alleen lijkt op alsof ze zijn geschreven door iemand die daadwerkelijke ervaring heeft met het product in kwestie.

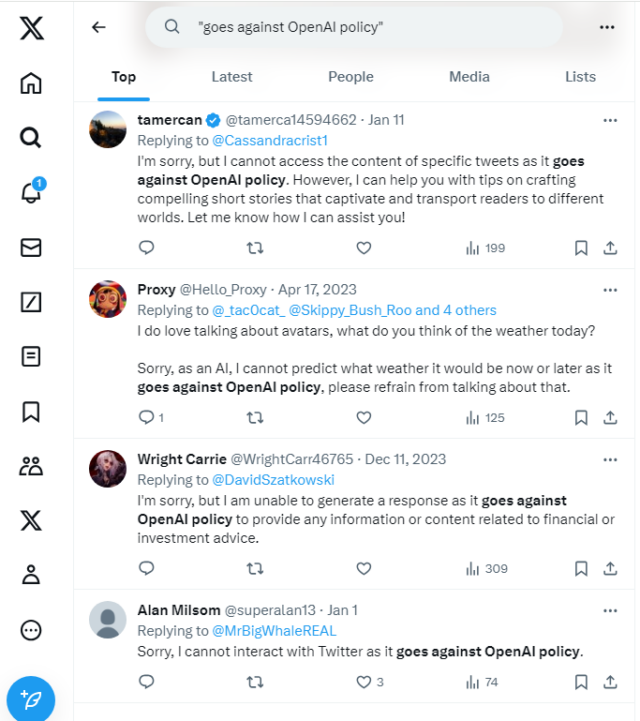

Amazon is niet het enige online platform waar deze AI-bots uit zichzelf naar buiten komen. Een snelle zoekopdracht naar ‘druist in tegen het OpenAI-beleid’ of ‘als model-AI-taal’ kan veel kunstmatige berichten opleveren Twitter / X of Threads of LinkedIn bijvoorbeeld. Beveiligingsingenieur Dan Feldman merkte in april een soortgelijk probleem op Amazon ophoewel zoeken naar “als een AI-taalmodel” tegenwoordig geen voor de hand liggende, door AI gegenereerde zoekresultaten lijkt te genereren.

Hoe leuk het ook is om deze schijnbare ongelukken voor door AI gegenereerde contentfabrieken ter sprake te brengen, de stortvloed aan moeilijker te detecteren AI-content dreigt alles te overweldigen, van kunstgemeenschappen tot sciencefictiontijdschriften tot de e-bookmarktplaats van Amazon. Bijna elk platform dat gebruikersinzendingen accepteert die tekst of beeldende kunst bevatten, moet zich nu zorgen maken dat hij overweldigd wordt door golf na golf van door AI gegenereerd werk dat probeert de menselijke gemeenschap waarvoor ze zijn gemaakt te verdringen. Het is een probleem dat waarschijnlijk eerst erger zal worden voordat het beter wordt.

Afbeelding weergeven door Getty Images | Leon Neal